Фильтры Google: их виды и методы борьбы с ними

Поисковая система Google — признанный лидер по числу обрабатываемых запросов в сутки. За последнее десятилетие она создала более 100 региональных версий, а в некоторых странах остается первой и единственной поисковой системой.

В этой статье речь пойдет об алгоритмах Гугла и его механизмах фильтрации поисковой выдачи. Эта информация необходима как специалистам SEO, так и пользователям, чьи сайты могут оказаться в зоне риска.

Классификация фильтров поисковой системы Гугл

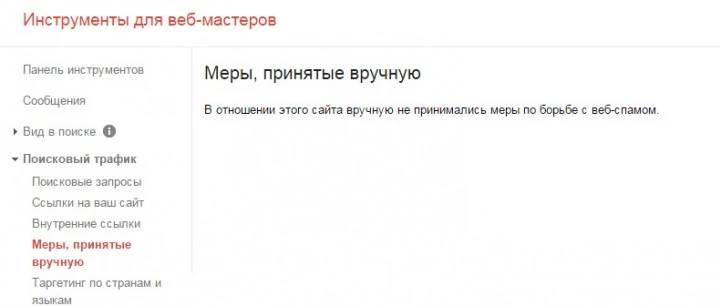

Разделяют ручные и автоматические (алгоритмические) методы наложения фильтров. Ручные санкции применяются модераторами при проверке сайта в том случае, если алгоритм ПС оказался не способен определить необходимость фильтрации. Как правило, ручные санкции гораздо проще снять после переговоров с поддержкой поисковой системы Google, так как модератор четко указывает причину наложения фильтра. Но если сайт попал под алгоритмический фильтр Гугла, то быстро проверить, какой именно вид санкций применен, не так просто. Веб-мастер не предоставит вам никакой информации, и необходимые решения придется искать самостоятельно.

Проверка и вывод сайта из-под ручных фильтров Гугла

Ручные санкции накладываются в том случае, если применялись:

- дорвейные технологии;

- искусственные SEO-ссылки;

- агрессивный спам ключевыми словами;

- технологии черного SEO (создание дорвеев, клоакинг, сокрытие текста, сателлиты, маскировка отдельных элементов сайта);

- некачественный, неуникальный и спамный контент.

Проверить сайт на предмет попадания под ручной фильтр поисковой системы легко в панели Google Webmaster Tools. В случае если для Вашего сайта ручные санкции не применялись, в меню «Инструменты для веб-мастеров» Вы увидите следующее сообщение:

Тем не менее, если ручной фильтр был применен, то для выхода сайта из-под него требуется внимательно ознакомиться с информацией в вышеназванной вкладке и следовать указанным инструкциям для устранения проблем.

Как узнать, что сайт попал под автоматический фильтр Google?

Фильтров в поисковой системе Гугл очень много, и быстро проверить, какой именно тип санкций был применен, довольно сложно. ПС учитывают множество факторов ранжирования площадок, и задача любого поисковика — сделать выдачу максимально релевантной. Однако ошибаться могут даже машины, и Гугл в этом плане не исключение.

Ваш ресурс мог оказаться под фильтром, если Вы не манипулировали выдачей, не накручивали ссылочную массу и ключи и в целом не злоупотребляли черным и серым SEO, однако заметили, что в один период:

- резко упал трафик;

- в Google Webmaster Tools появилось сообщение, что обнаружены искусственные ссылки на сайт.

Перечислим некоторые фильтры Гугла:

- «Песочница»;

- Domain name Age («Возраст домена»);

- Google Omitted Results («Дополнительные результаты»);

- Page Load Time («Длительное время загрузки»);

- Broken Link Filter («Много битых ссылок»);

- Bombing («Бомбежка»);

- Bowling («Боулинг»);

- Too Many Links at once («Много ссылок сразу»);

- Links («Линкопомойки»);

- CO-citation Linking Filter («Социтирование»);

- -30 («Минус тридцать»);

- Duplicate Content («Дублирующийся контент»);

- Over Optimization («Чрезмерная оптимизация»);

- Google page layout («Много рекламы в верхней части страницы»);

- Фильтр за всплывающие окна;

- Google Panda;

- Google Penguin.

Рассмотрим несколько самых серьезных фильтров Гугла.

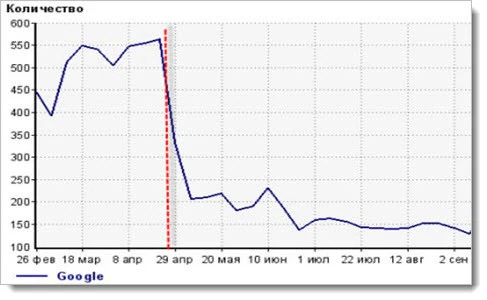

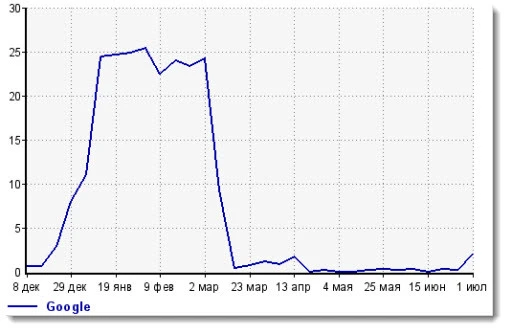

Penguin («Пингвин»)

Был запущен в 2012 году. Попадание под этот фильтр характеризуется резким падением трафика. Как правило, проседание совпадает с моментом переиндексации выдачи. Этот фильтр «наказывает» площадки за неестественную ссылочную массу. Если после очередного обновления алгоритма Вы заметили проседание трафика на сайт, то, вероятно, к ресурсу были применены санкции.

Как выглядит график посещаемости сайта под фильтром Penguin:

К манипулированию ссылочной массой Гугл относит:

- присутствие в анкоре ссылки прямого вхождения ключевого запроса;

- размещение ссылочной массы на некачественных и спамных площадках;

- присутствие сквозных ссылок в сайдбаре и/или футере;

- ссылочный обмен;

- хаотичное и неравномерное распределение анкоров по страницам ресурса.

Метод вывода сайта из-под фильтра довольно прост: достаточно убрать некачественные и неестественные ссылки, устранить внутренние ошибки (клоакинг, дубли) и постепенно наращивать естественную ссылочную массу без резкого увеличения этих ссылок.

Некорректные ссылки могут возникать по разным причинам, и самая распространенная — некачественные работы, проведенные по внешней SЕО-оптимизации. Например, покупные ссылки на сайт, за которые Гугл может применить санкции.

Нередко встречаются ситуации по обнаружению ссылок на ресурс, которые были проставлены конкурентами с сайтов с взрослой тематикой или с вредоносными источниками. Также до сих пор встречаются сайты с огромным количеством ссылок, проставленных в те годы, когда определяющим фактором было не качество ссылок, а их количество.

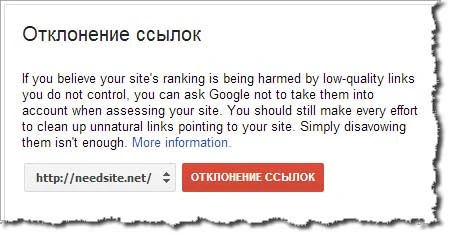

Обычно ссылки можно удалить через переписку с веб-мастерами площадок, с которых они ведут. Но бывают случаи, когда это невозможно. В таких ситуациях проводится так называемое дезавуирование ссылок.

Слово «дезавуирование» произошло от фр. desavouer — «отказываться», «выражать неодобрение». Таким образом, дезавуирование ссылок — это процесс, при котором владелец ресурса указывает поисковику, что данные ссылки не нужно учитывать при ранжировании сайта, и снимает с себя ответственность за их появление.

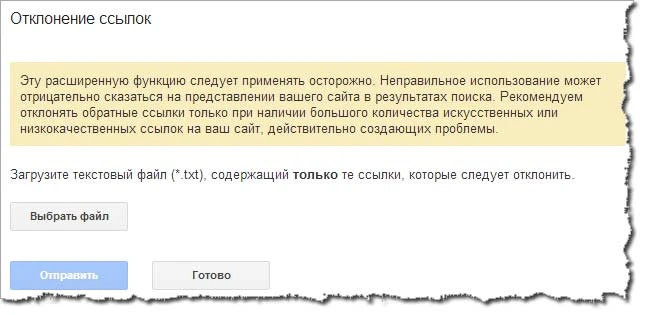

Дезавуировать нежелательные ссылки сам Гугл рекомендует с помощью инструмента Disavow Links.

Правила использования сервиса:

Шаг первый. Переходим на страницу Disavow Links Tool и выбираем наш домен:

Шаг второй. Загружаем txt-файл со списком ссылок, которые необходимо удалить. Кодировка файла — UTF-8 или 7-bit ASCII. Каждую ссылку требуется писать с новой строки, также можно запретить и домен, и отдельную страницу сайта, используя команду domain. При необходимости оставить комментарий нужно проставить в начале строки символ #.

ВАЖНО: размер загружаемого файла не должен превышать 2 Мб.

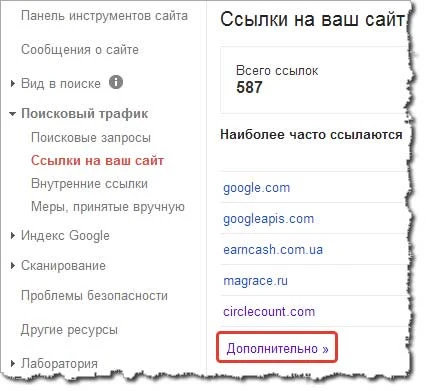

Ссылки, индексируемые Google, вы можете проверить в панели веб-мастера:

Шаг третий: Ждем новой индексации с учетом загруженных запретов (этот процесс может занять от нескольких дней до месяца) и после отправляем сайт на пересмотр: https://www.google.com/webmasters/

Panda («Панда»)

Этот пессимизирующий фильтр поисковой системы Google был введен в 2011 году. Его основная цель — борьба с некачественным контентом и рекламой, не имеющей отношения к тематике текста, а также целостная оценка наполнения сайта.

Так выглядит график посещаемости сайта, попавшего под фильтр Panda:

Чтобы избежать фильтра «Панда», на Вашем сайте не должны присутствовать:

- неуникальные, скопированные тексты;

- нетематические ссылки;

- спам ключевыми словами, переоптимизация;

- неуникальные метатеги, дубли страниц и пр.

Процесс вывода сайта из-под фильтра «Панда» трудозатратный и долгий. Необходимо провести работы по комплексному аудиту, уделить внимание каждой странице, исправить каждую внутреннюю техническую ошибку. Подробно об этом фильтре Вы можете прочитать в нашей статье.

Что необходимо делать, чтобы не попадать под фильтры поисковой системы Google?

В первую очередь не следует нарушать правила честной оптимизации. Рекомендации по основам адекватной оптимизации дают как крупные компании по продвижению, так и сами поисковые системы. Наполнять страницы следует только уникальным и интересным для пользователей контентом. Необходимо избегать резкого роста ссылочной массы, возникновения дублей страниц или всего сайта. Нельзя размещать нетематическую рекламу и пренебрегать основами юзабилити, следует оперативно проверять сайт и исправлять возникающие технические ошибки.

всем новым подписчикам

Мы ежедневно создаем интересный и полезный для бизнеса контент. Публикуем статьи и исследования рынка, советы от экспертов отрасли, организуем вебинары и консультации по продвижению бизнеса с учетом текущих условий. Размещаем обзоры и репортажи с крупных выставок.

Подписывайтесь и применяйте полученные знания на практике!